Импакт-фактор (англ. словосочетание impact factor можно перевести как показатель влияния. Соответственно, если имеется в виду импакт-фактор журнала, то речь идет о наукометрическом индикаторе, свидетельствующем о научной значимости издания.

Содержание:

- Что такое импакт-фактор

- Импакт-фактор в Web of Science

- Как узнать импакт-фактор в Scopus

- Импакт-фактор научных журналов в РИНЦ

- Методика расчета импакт-фактора

- Как присваивается импакт-фактор?

- Почему важен Impact-Factor?

Может ли такая значимость в научной среде быть выражена в количественных показателях? Да, в реальности impact-factor – сугубо формальный критерий. Но именно он отражает популярность журнала, доверие исследовательского сообщества и авторитетных авторов.

Что такое импакт-фактор научного издания и как он вычисляется

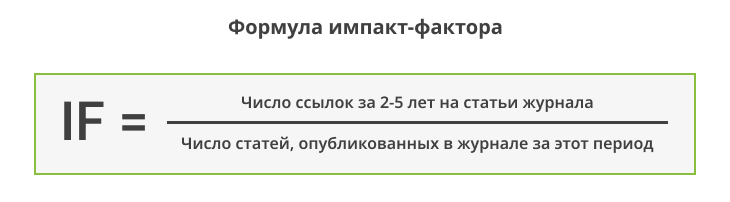

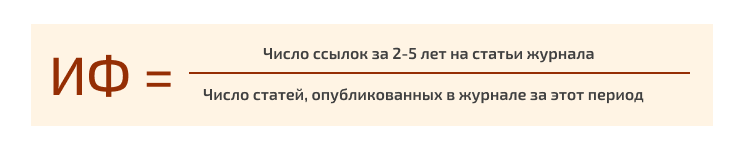

Главный показатель важности научного журнала – цитируемость. Чем больше ссылок на статьи, опубликованные в издании, тем оно более узнаваемо, популярно, востребовано. Стандартно импакт-фактор рассчитывается по простой формуле:

ГИФ = ЦИТ / ПУБ,

где ГИФ – искомый годовой импакт-фактор;

ЦИТ – количество процитированных статей, опубликованных за определенный период (чаще всего берутся 3 или 5 предыдущих лет);

ПУБ – общее количество опубликованных статей за тот же период.

Очевидно, что такой подход носит излишне формальный характер. Поэтому авторитетные наукометрические базы используют усовершенствованные формулы для вычисления разных видов уровня влиятельности. В такие формулы включаются:

- сфера исследований;

- взвешенное количество цитат;

- авторитетность изданий, где цитировались статьи из оцениваемого журнала;

- сравнение ожидаемого уровня и фактического показателя.

Эти и другие дополнения позволяют объективнее оценить значимость научного журнала среди ученого сообщества в конкретной сфере исследований.

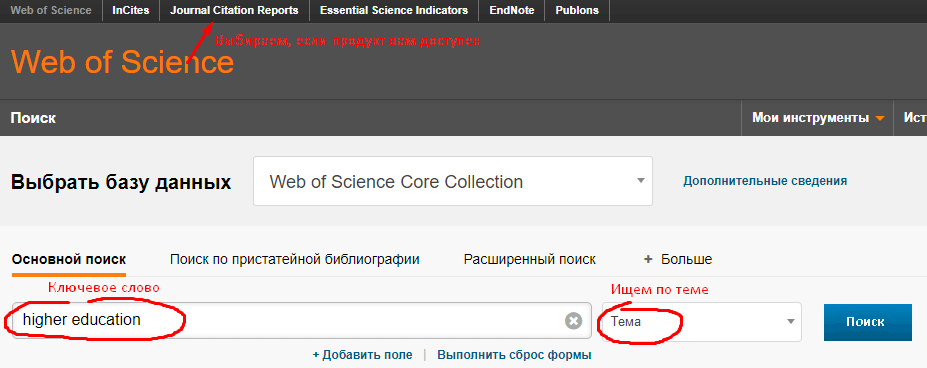

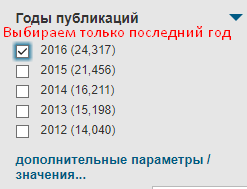

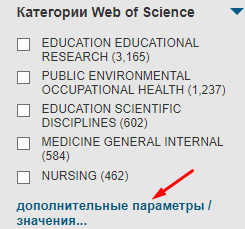

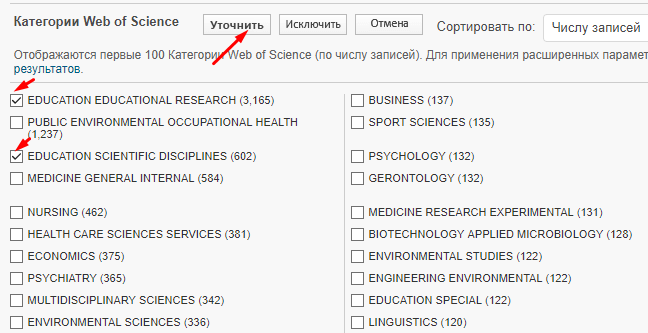

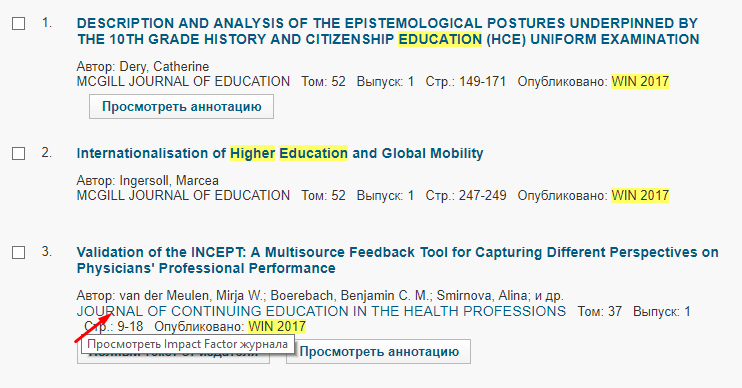

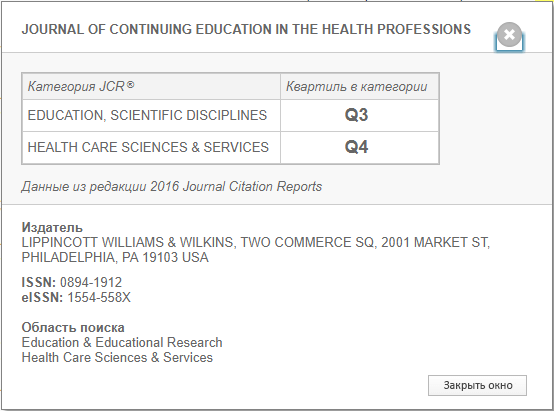

Импакт-фактор журналов в Web of Science

Наукометрическая база Web of Science (WoS) – одна из самых авторитетных. Однако простой доступ к системе не позволит вам ознакомиться с импакт-факторами включенных в нее журналов. Здесь нужна платная подписка на отчеты по импакт-факторам JCR (Journal Citation Reports).

Подробнее читайте здесь: Как найти квартиль журнала в Web of Science?

Показатели JCR публикует сервис Clarivate Analytics. На нем можно увидеть, насколько влиятельным был сборник на протяжении 2–3 лет.

На самом сайте Web of Science узнать JCR можно так:

- зайдите на webofscience.com;

- в верхнем меню выберите Journal Citation Reports;

- проведите поиск статей по темам, ключевым словам;

- у каждого материала есть ссылка на издание, где он опубликован;

- нажмите на ссылку, и система выдаст статистические параметры журнала (полнота информации зависит от уровня подписки пользователя).

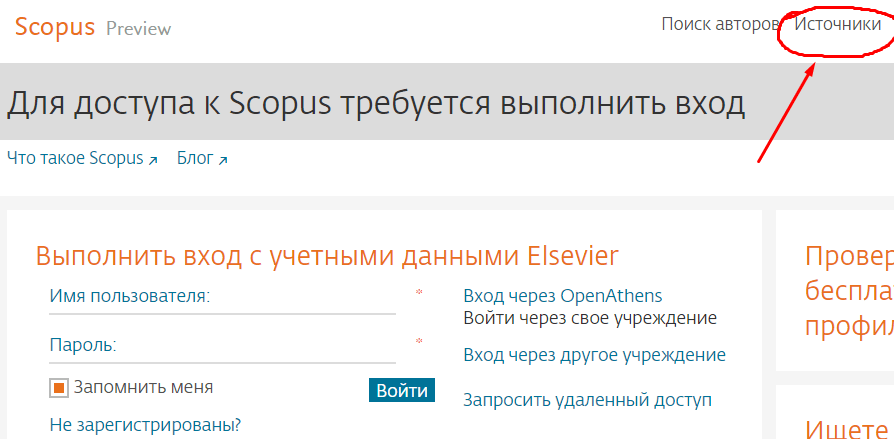

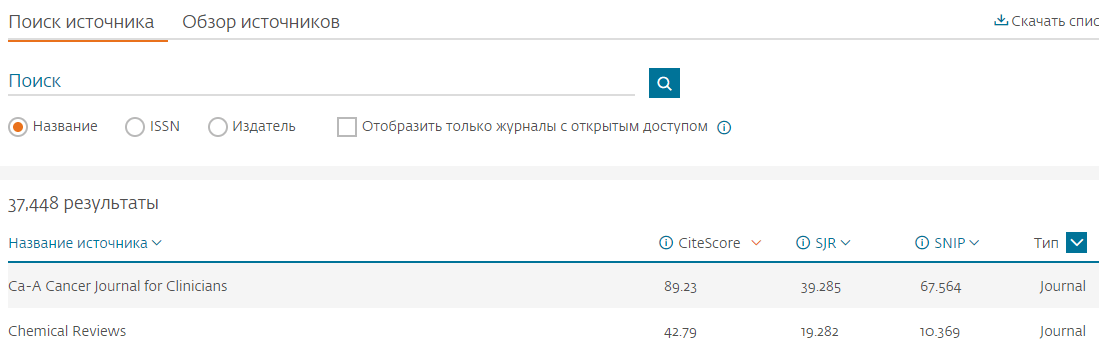

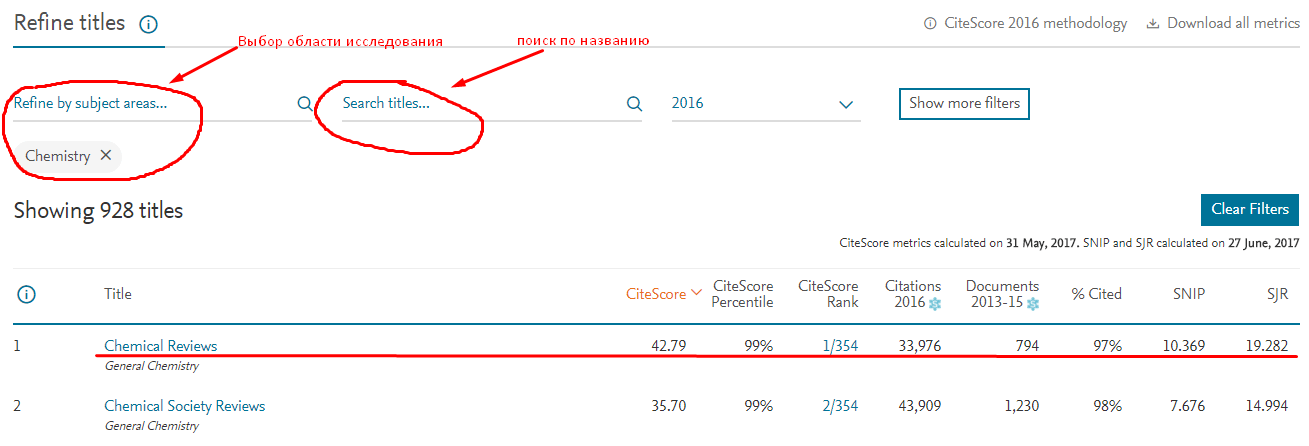

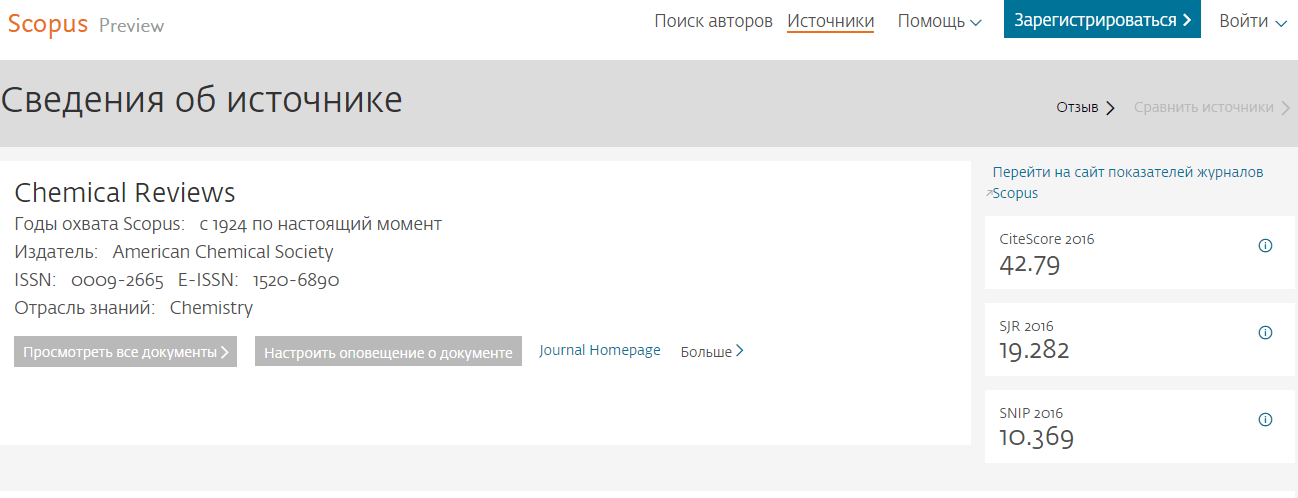

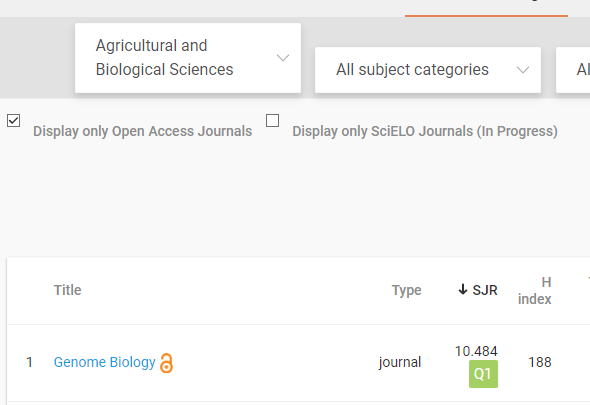

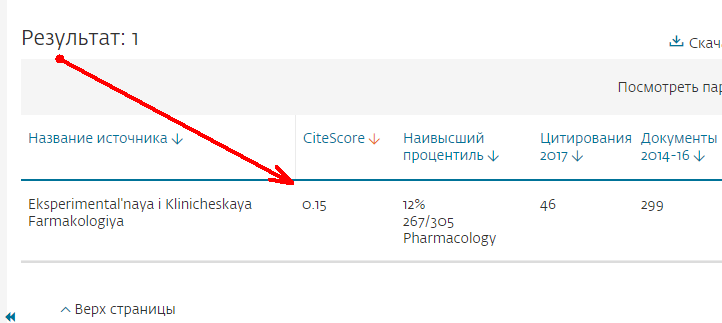

Как узнать импакт-фактор журнала в Scopus

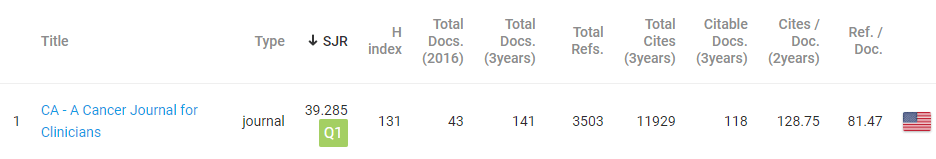

ИФ журналов Scopus рассчитывается сразу по трем показателям:

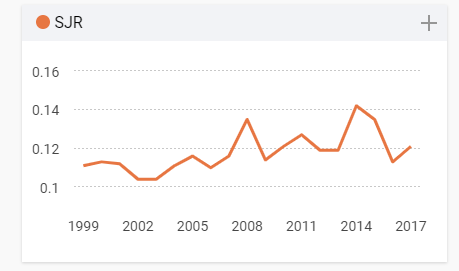

- SCImago Journal Rank – взвешенная численность цитат. Здесь учитывается не просто соотношение числа цитирований и общее количество опубликованных статей. Учитываются специфика отрасли научных знаний и авторитет журнала, в котором использованы цитаты. Поэтому показатель SJR считается одним из наиболее ценных;

- SNIP – нормированный по конкретным источникам уровень цитирования материала. Здесь подсчет ведется с учетом предварительных ожиданий по количеству цитат в специализированных сборниках. Этот параметр интересен с точки зрения того, насколько стала важна статья в узких кругах специалистов;

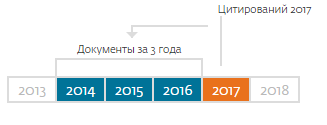

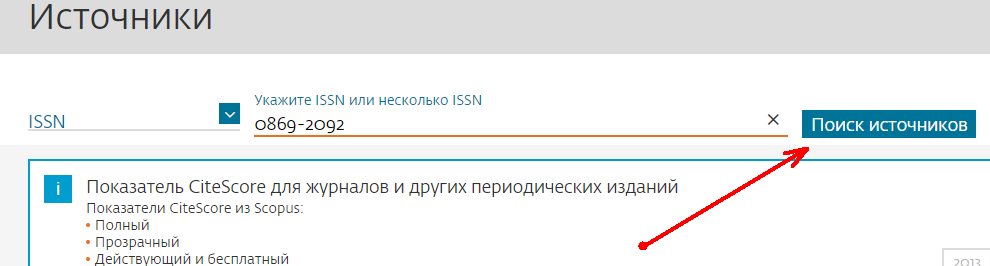

- CiteScore – общий количественно-рейтинговый показатель. По указанной выше формуле высчитывается среднее количество цитирований, получаемое материалами, опубликованными в сборнике.

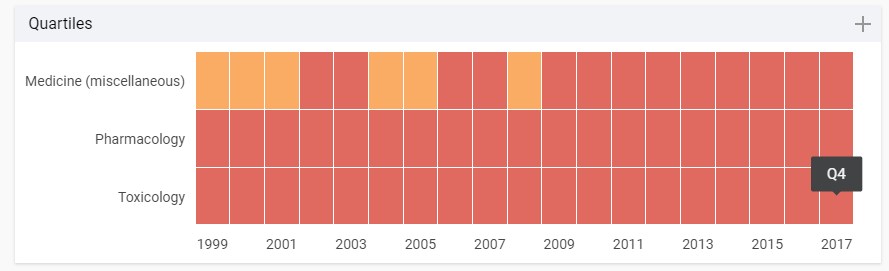

Подробнее читайте здесь: Что такое квартиль и SJR журнала в Scopus, и как определить?

Чтобы узнать перечисленные характеристики, следуем такому алгоритму действий:

- заходим на портал наукометрической базы данных Scopus;

- проводим поиск в каталоге журналов (по ключевым словам, названию, сфере исследований, издателю, ISSN);

- если удалось найти требуемое издание, нажимаем на его название, отображаемое активной ссылкой;

- появляется таблица с отображаемыми CiteScore, SJR, SNIP (чем выше показатель по каждому параметру, тем лучше).

Во многих вузах от ученых требуют подтверждать свою квалификацию. Публиковаться можно и в российских изданиях, но международные научные журналы ценятся больше.

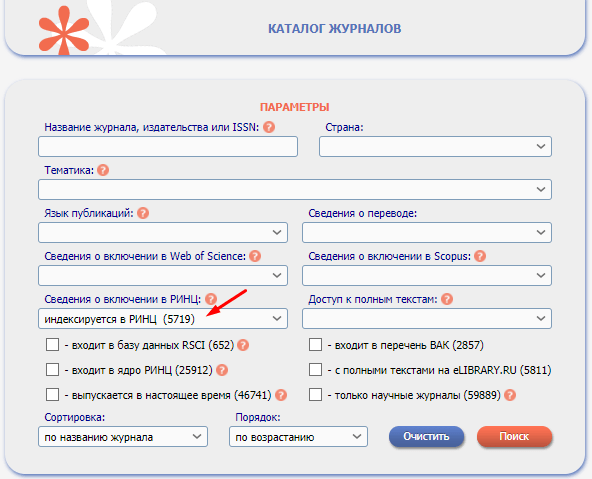

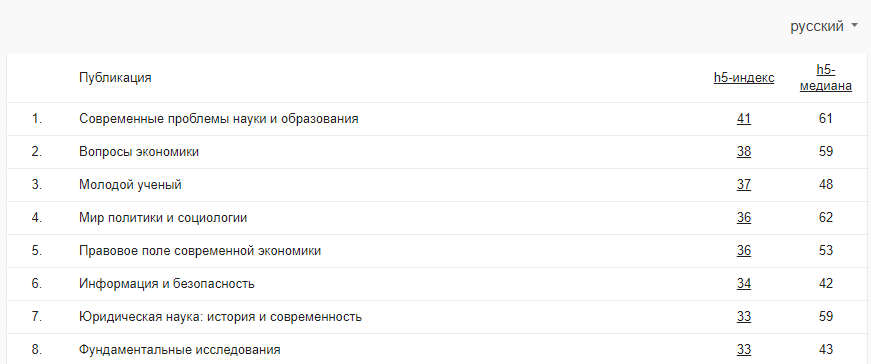

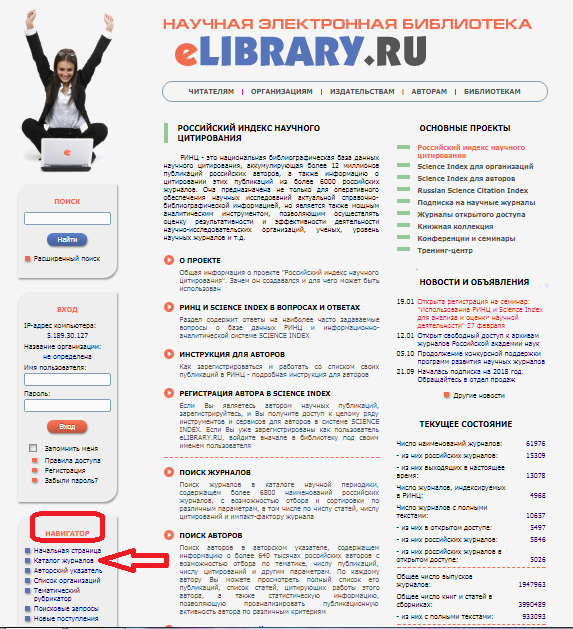

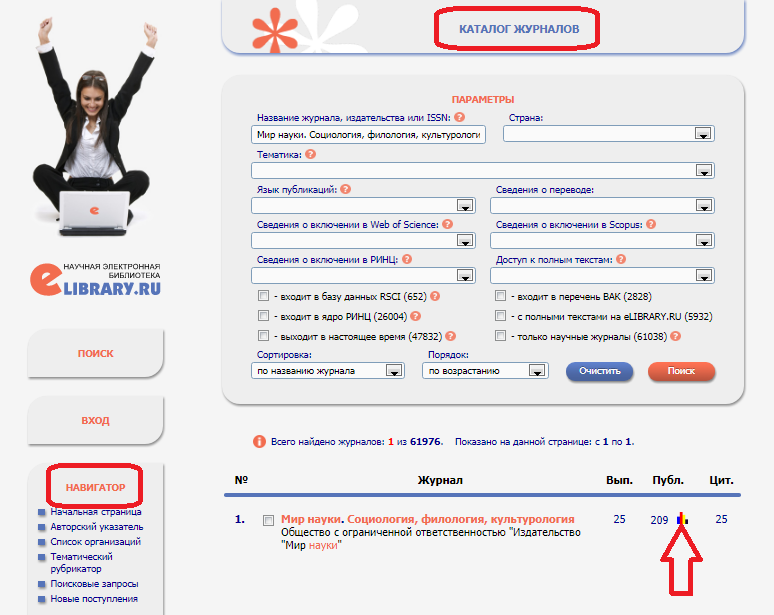

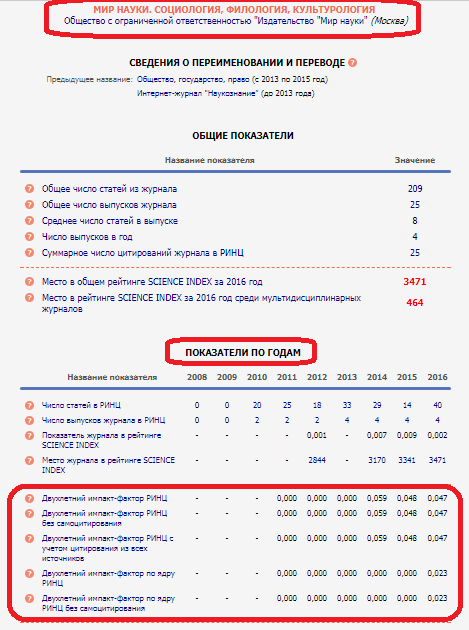

Импакт-фактор научных журналов в РИНЦ

Количество публикаций в мире ежедневно увеличивается. На сегодня отечественная база данных РИНЦ насчитывает более десятка миллионов публикаций.

Индекс цитирования, позволяющий ранжировать журналы по количеству ссылок на статьи, опубликованные в нем, получил название импакт-фактор в РИНЦ. Это один из важнейших в настоящий момент критериев оценки научной значимости отечественных научных журналов.

К несомненным достоинствам индикатора можно отнести:

- Массовый охват периодической литературы во всех областях научного знания.

- Доступность оценок для исследователей и профессиональных ученых, широкого круга лиц, общественности.

- Жесткий контроль соответствия информации критериям знания.

Очень часто индекс используют для оценки влияния автора статьи или опубликованного в статье исследования на определенную область знания. Вместе с тем такой подход не соответствует действительности. Численный показатель позволяет оценить важность научного журнала, а не исследователя или статьи. Чтобы избежать ошибок, используют специальные методики расчета.

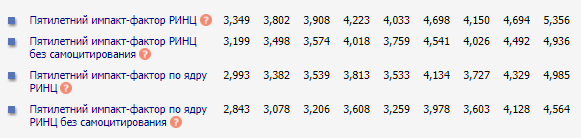

Методика расчета импакт-фактора в РИНЦ

Несмотря на то, что методика ранжирования журналов в каждой базе имеет свои особенности, существует общая формула для расчета импакт-фактора.

Как присваивается импакт-фактор?

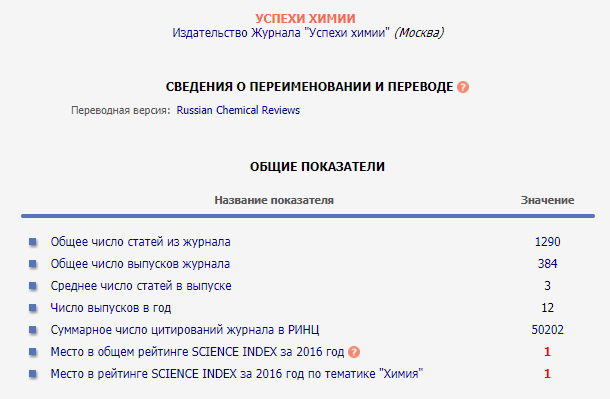

Особое место в системе ранжирования занимают журналы, менявшие название, в том числе и несколько раз. Если по какому-то конкретному изданию индекс присваивался, но в настоящее время оно не выходит в свет, то их показатели не публикуются, а импакт-фактор не присваивается.

Для новых изданий обязательное условие присвоения показателя важности журнала – наличие всех выпусков с момента основания издания. Кроме этого, определенное условие – сроки существования. В зависимости от выбранной методики расчета это может быть два или три года.

Переименование также способно существенно повлиять на характеристики и оценку в академической и профессиональной среде важности периодики. Например, если у русскоязычного журнала появилось оригинальное название на иностранном языке, то для оценки берутся ссылки на оригинальную версию и на иностранный перевод. При частичном переводе (некоторые статьи, выпуски) для расчета берется только часть материала на иностранном языке.

Высокий ИФ способен значительно поднять авторитет издания в профессиональной среде. Особенно благоприятно складывается ситуация для отечественной периодики.

Почему важен impact-factor?

Чем престижнее издание, публикующее научные статьи, тем больше ученых в разных странах мира ознакомятся с вашим исследованием. Для амбициозного ученого в этом состоит главная цель деятельности – создать знание, полезное для международного сообщества.

Важно не только найти издания с высоким импакт-фактором. Необходимо учесть все сложные требования к публикуемым материалам, написать текст на соответствующем языке. В этом вам помогут опытные специалисты нашего издательства.

This article is about a measure of journal influence. For other similar metrics, see Citation impact.

The impact factor (IF) or journal impact factor (JIF) of an academic journal is a scientometric index calculated by Clarivate that reflects the yearly mean number of citations of articles published in the last two years in a given journal, as indexed by Clarivate’s Web of Science. As a journal-level metric, it is frequently used as a proxy for the relative importance of a journal within its field; journals with higher impact factor values are given the status of being more important, or carry more prestige in their respective fields, than those with lower values. While frequently used by universities and funding bodies to decide on promotion and research proposals, it has come under attack for distorting good scientific practices.[1][2][3]

History[edit]

The impact factor was devised by Eugene Garfield, the founder of the Institute for Scientific Information (ISI) in Philadelphia. Impact factors began to be calculated yearly starting from 1975 for journals listed in the Journal Citation Reports (JCR). ISI was acquired by Thomson Scientific & Healthcare in 1992,[4] and became known as Thomson ISI. In 2018, Thomson-Reuters spun off and sold ISI to Onex Corporation and Baring Private Equity Asia.[5] They founded a new corporation, Clarivate, which is now the publisher of the JCR.[6]

Calculation[edit]

In any given year, the two-year journal impact factor is the ratio between the number of citations received in that year for publications in that journal that were published in the two preceding years and the total number of «citable items» published in that journal during the two preceding years:[7][8]

For example, Nature had an impact factor of 41.577 in 2017:[9]

This means that, on average, its papers published in 2015 and 2016 received roughly 42 citations each in 2017. 2017 impact factors are reported in 2018; they cannot be calculated until all of the 2017 publications have been processed by the indexing agency.

The value of impact factor depends on how to define «citations» and «publications»; the latter are often referred to as «citable items». In current practice, both «citations» and «publications» are defined exclusively by ISI as follows. «Publications» are items that are classed as «article», «review» or «proceedings paper»[10] in the Web of Science (WoS) database; other items like editorials, corrections, notes, retractions and discussions are excluded. WoS is accessible to all registered users, who can independently verify the number of citable items for a given journal. In contrast, the number of citations is extracted not from the WoS database, but from a dedicated JCR database, which is not accessible to general readers. Hence, the commonly used «JCR Impact Factor» is a proprietary value, which is defined and calculated by ISI and can not be verified by external users.[11]

New journals, which are indexed from their first published issue, will receive an impact factor after two years of indexing; in this case, the citations to the year prior to volume 1, and the number of articles published in the year prior to volume 1, are known zero values. Journals that are indexed starting with a volume other than the first volume will not get an impact factor until they have been indexed for three years. Occasionally, Journal Citation Reports assigns an impact factor to new journals with less than two years of indexing, based on partial citation data.[12][13] The calculation always uses two complete and known years of item counts, but for new titles one of the known counts is zero. Annuals and other irregular publications sometimes publish no items in a particular year, affecting the count. The impact factor relates to a specific time period; it is possible to calculate it for any desired period. For example, the JCR also includes a five-year impact factor, which is calculated by dividing the number of citations to the journal in a given year by the number of articles published in that journal in the previous five years.[14][15]

Use[edit]

While originally invented as a tool to help university librarians to decide which journals to purchase, the impact factor soon became used as a measure for judging academic success. This use of impact factors was summarised by Hoeffel in 1998:[16]

Impact Factor is not a perfect tool to measure the quality of articles but there is nothing better and it has the advantage of already being in existence and is, therefore, a good technique for scientific evaluation. Experience has shown that in each specialty the best journals are those in which it is most difficult to have an article accepted, and these are the journals that have a high impact factor. Most of these journals existed long before the impact factor was devised. The use of impact factor as a measure of quality is widespread because it fits well with the opinion we have in each field of the best journals in our specialty….In conclusion, prestigious journals publish papers of high level. Therefore, their impact factor is high, and not the contrary.

As impact factors are a journal-level metric, rather than an article- or individual-level metric, this use is controversial. Eugene Garfield, the inventor of the JIF agreed with Hoeffel,[17] but warned about the «misuse in evaluating individuals» because there is «a wide variation [of citations] from article to article within a single journal».[18] Despite this warning, the use of the JIF has evolved, playing a key role in the process of assessing individual researchers, their job applications and their funding proposals. In 2005, The Journal of Cell Biology noted that:

Impact factor data … have a strong influence on the scientific community, affecting decisions on where to publish, whom to promote or hire, the success of grant applications, and even salary bonuses.[19]

More targeted research has begun to provide firm evidence of how deeply the impact factor is embedded within formal and informal research assessment processes. A review in 2019 studied how often the JIF featured in documents related to the review, promotion, and tenure of scientists in US and Canadian universities. It concluded that 40% of universities focussed on academic research specifically mentioned the JIF as part of such review, promotion, and tenure processes.[20] And a 2017 study of how researchers in the life sciences behave concluded that «everyday decision-making practices as highly governed by pressures to publish in high-impact journals». The deeply embedded nature of such indicators not only effect research assessment, but the more fundamental issue of what research is actually undertaken: «Given the current ways of evaluation and valuing research, risky, lengthy, and unorthodox project rarely take center stage.»[21]

Criticism[edit]

Numerous critiques have been made regarding the use of impact factors, both in terms of its statistical validity and also of its implications for how science is carried out and assessed.[3][22][23][24][25] A 2007 study noted that the most fundamental flaw is that impact factors present the mean of data that are not normally distributed, and suggested that it would be more appropriate to present the median of these data.[19] There is also a more general debate on the validity of the impact factor as a measure of journal importance and the effect of policies that editors may adopt to boost their impact factor (perhaps to the detriment of readers and writers). Other criticism focuses on the effect of the impact factor on behavior of scholars, editors and other stakeholders.[26] Further criticisms argue that emphasis on impact factor results from the negative influence of neoliberal politics on academia. Some of these arguments demand not just replacement of the impact factor with more sophisticated metrics but also discussion on the social value of research assessment and the growing precariousness of scientific careers in higher education.[27][28]

Inapplicability of impact factor to individuals and between-discipline differences[edit]

It has been stated that impact factors in particular and citation analysis in general are affected by field-dependent factors[29] which invalidate comparisons not only across disciplines but even within different fields of research of one discipline.[30] The percentage of total citations occurring in the first two years after publication also varies highly among disciplines from 1–3% in the mathematical and physical sciences to 5–8% in the biological sciences.[31] Thus impact factors cannot be used to compare journals across disciplines.

Impact factors are sometimes used to evaluate not only the journals but the papers therein, thereby devaluing papers in certain subjects.[32] In 2004, the Higher Education Funding Council for England was urged by the House of Commons Science and Technology Select Committee to remind Research Assessment Exercise panels that they are obliged to assess the quality of the content of individual articles, not the reputation of the journal in which they are published.[33] Other studies have repeatedly stated that impact factor is a metric for journals and should not be used to assess individual researchers or institutions.[34][35][36]

Questionable editorial policies that affect the impact factor[edit]

Because impact factor is commonly accepted as a proxy for research quality, some journals adopt editorial policies and practices, some acceptable and some of dubious purpose, to increase its impact factor.[37][38] For example, journals may publish a larger percentage of review articles which generally are cited more than research reports.[8] Research undertaken in 2020 on dentistry journals concluded that the publication of «systematic reviews have significant effect on the Journal Impact Factor … while papers publishing clinical trials bear no influence on this factor. Greater yearly average of published papers … means a higher impact factor.»[39]

Journals may also attempt to limit the number of «citable items»—i.e., the denominator of the impact factor equation—either by declining to publish articles that are unlikely to be cited (such as case reports in medical journals) or by altering articles (e.g., by not allowing an abstract or bibliography in hopes that Journal Citation Reports will not deem it a «citable item»). As a result of negotiations over whether items are «citable», impact factor variations of more than 300% have been observed.[40] Items considered to be uncitable—and thus are not incorporated in impact factor calculations—can, if cited, still enter into the numerator part of the equation despite the ease with which such citations could be excluded. This effect is hard to evaluate, for the distinction between editorial comment and short original articles is not always obvious. For example, letters to the editor may be part of either class.

Another less insidious tactic journals employ is to publish a large portion of its papers, or at least the papers expected to be highly cited, early in the calendar year. This gives those papers more time to gather citations. Several methods, not necessarily with nefarious intent, exist for a journal to cite articles in the same journal which will increase the journal’s impact factor.[41][42]

Beyond editorial policies that may skew the impact factor, journals can take overt steps to game the system. For example, in 2007, the specialist journal Folia Phoniatrica et Logopaedica, with an impact factor of 0.66, published an editorial that cited all its articles from 2005 to 2006 in a protest against the «absurd scientific situation in some countries» related to use of the impact factor.[43] The large number of citations meant that the impact factor for that journal increased to 1.44. As a result of the increase, the journal was not included in the 2008 and 2009 Journal Citation Reports.[44]

Coercive citation is a practice in which an editor forces an author to add extraneous citations to an article before the journal will agree to publish it, in order to inflate the journal’s impact factor.[45] A survey published in 2012 indicates that coercive citation has been experienced by one in five researchers working in economics, sociology, psychology, and multiple business disciplines, and it is more common in business and in journals with a lower impact factor.[46] Editors of leading business journals banded together to disavow the practice.[47] However, cases of coercive citation have occasionally been reported for other disciplines.[48]

Assumed correlation between impact factor and quality[edit]

The journal impact factor was originally designed by Eugene Garfield as a metric to help librarians make decisions about which journals were worth indexing, as the JIF aggregates the number of citations to articles published in each journal. Since then, the JIF has become associated as a mark of journal «quality», and gained widespread use for evaluation of research and researchers instead, even at the institutional level. It thus has significant impact on steering research practices and behaviours.[49][50][51]

By 2010, national and international research funding institutions were already starting to point out that numerical indicators such as the JIF should not be considered as a measure of quality.[note 1] In fact, research was indicating that the JIF is a highly manipulated metric,[52][53][54] and the justification for its continued widespread use beyond its original narrow purpose seems due to its simplicity (easily calculable and comparable number), rather than any actual relationship to research quality.[55][56][57]

Empirical evidence shows that the misuse of the JIF—and journal ranking metrics in general—has a number of negative consequences for the scholarly communication system. These include gaps between the reach of a journal and the quality of its individual papers[25] and insufficient coverage of social sciences and humanities as well as research outputs from across Latin America, Africa, and South-East Asia.[citation needed] Additional drawbacks include the marginalization of research in vernacular languages and on locally relevant topics and inducement to unethical authorship and citation practices. More generally, the impact factors fosters a reputation economy, where scientific success is based on publishing in prestigious journals ahead of actual research qualities such as rigorous methods, replicability and social impact. Using journal prestige and the JIF to cultivate a competition regime in academia has been shown to have deleterious effects on research quality.[58]

A number of regional and international initiatives are now providing and suggesting alternative research assessment systems, including key documents such as the Leiden Manifesto[note 2] and the San Francisco Declaration on Research Assessment (DORA). Plan S calls for a broader adoption and implementation of such initiatives alongside fundamental changes in the scholarly communication system.[note 3] As appropriate measures of quality for authors and research, concepts of research excellence should be remodelled around transparent workflows and accessible research results.[59][60][61]

JIFs are still regularly used to evaluate research in many countries, which is a problem since a number of issues remain around the opacity of the metric and the fact that it is often negotiated by publishers.[62][63][19]

Negotiated values[edit]

Results of an impact factor can change dramatically depending on which items are considered as «citable» and therefore included in the denominator.[64] One notorious example of this occurred in 1988 when it was decided that meeting abstracts published in FASEB Journal would no longer be included in the denominator. The journal’s impact factor jumped from 0.24 in 1988 to 18.3 in 1989.[65] Publishers routinely discuss with Clarivate how to improve the «accuracy» of their journals’ impact factor and therefore get higher scores.[40][25]

Such discussions routinely produce «negotiated values» which result in dramatic changes in the observed scores for dozens of journals, sometimes after unrelated events like the purchase by one of the larger publishers.[66]

Distribution skewness[edit]

Journal impact factors are influenced heavily by a small number of highly cited papers. In general, most papers published in 2013–14 received many fewer citations than indicated by the impact factor. Two journals (Nature [blue], PLOS ONE [orange]) are shown to represent a highly cited and less cited journal, respectively. The high citation impact of Nature is derived from relatively few highly cited papers. Modified after Callaway 2016.[67]

Because citation counts have highly skewed distributions,[24] the mean number of citations is potentially misleading if used to gauge the typical impact of articles in the journal rather than the overall impact of the journal itself.[68] For example, about 90% of Nature‘s 2004 impact factor was based on only a quarter of its publications. Thus the actual number of citations for a single article in the journal is in most cases much lower than the mean number of citations across articles.[69] Furthermore, the strength of the relationship between impact factors of journals and the citation rates of the papers therein has been steadily decreasing since articles began to be available digitally.[70]

The effect of outliers can be seen in the case of the article «A short history of SHELX», which included this sentence: «This paper could serve as a general literature citation when one or more of the open-source SHELX programs (and the Bruker AXS version SHELXTL) are employed in the course of a crystal-structure determination». This article received more than 6,600 citations. As a consequence, the impact factor of the journal Acta Crystallographica Section A rose from 2.051 in 2008 to 49.926 in 2009, more than Nature (at 31.434) and Science (at 28.103).[71] The second-most cited article in Acta Crystallographica Section A in 2008 had only 28 citations.[72]

Critics of the JIF state that use of the arithmetic mean in its calculation is problematic because the pattern of citation distribution is skewed[73] and citation distributions metrics have been proposed as an alternative to impact factors.[74][75][76]

However, there have also been pleas to take a more nuanced approach to judging the distribution skewness of the impact factor. Waltman and Traag[who?], in their 2021 paper, ran numerous simulations and concluded that «statistical objections against the use of the IF at the level of individual articles are not convincing», and that «the IF may be a more accurate indicator of the value of an article than the number of citations of the article».[1]

Lack of reproducibility[edit]

While the underlying mathematical model is publicly known, the dataset which is used to calculate the JIF is not publicly available. This prompted criticism: «Just as scientists would not accept the findings in a scientific paper without seeing the primary data, so should they not rely on Thomson Scientific’s impact factor, which is based on hidden data».[19] However, a 2019 article demonstrated that «with access to the data and careful cleaning, the JIF can be reproduced», although this required much labour to achieve.[77] A 2020 research paper went further. It indicated that by querying open access or partly open-access databases, like Google Scholar, ResearchGate, and Scopus, it is possible to calculate approximate impact factors without the need to purchase Web of Science / JCR.[78]

Broader negative impact on science[edit]

Just as the impact factor has attracted criticism for various immediate problems associated with its application, so has there also been criticism that its application undermines the broader process of science. Research has indicated that bibliometrics figures, particularly the impact factor, decrease the quality of peer review an article receiving,[79] a reluctance to share data,[21] decreasing quality of articles,[80] and a reduced scope in terms of what they can research. «For many researchers the only research questions and projects that appear viable are those that can meet the demand of scoring well in terms of metric performance indicators — and chiefly the journal impact factor.».[21] Furthermore, the process of publication and science is slowed down — authors automatically try and publish with the journals with the highest impact factor — «as editors and reviewers are tasked with reviewing papers that are not submitted to the most appropriate venues».[77]

Institutional responses to criticism of the impact factor[edit]

Given the growing criticism and its widespread usage as a means of research assessment, organisations and institutions have begun to take steps to move away from the journal impact factor. In November 2007 the European Association of Science Editors (EASE) issued an official statement recommending «that journal impact factors are used only—and cautiously—for measuring and comparing the influence of entire journals, but not for the assessment of single papers, and certainly not for the assessment of researchers or research programmes».[23]

In July 2008, the International Council for Science Committee on Freedom and Responsibility in the Conduct of Science issued a «statement on publication practices and indices and the role of peer review in research assessment», suggesting many possible solutions—e.g., considering a limit number of publications per year to be taken into consideration for each scientist, or even penalising scientists for an excessive number of publications per year—e.g., more than 20.[81]

In February 2010, the Deutsche Forschungsgemeinschaft (German Research Foundation) published new guidelines to reduce the number of publications that could be submitted when applying for funding: «The focus has not been on what research someone has done but rather how many papers have been published and where.» They noted that for decisions concerning «performance-based funding allocations, postdoctoral qualifications, appointments, or reviewing funding proposals, [where] increasing importance has been given to numerical indicators such as the h-index and the impact factor».[82] The UK’s Research Assessment Exercise for 2014 also banned the journal impact factor[83] although evidence suggested that this ban was often ignored.[84]

In response to growing concerns over the inappropriate use of journal impact factors in evaluating scientific outputs and scientists themselves, the American Society for Cell Biology together with a group of editors and publishers of scholarly journals created the San Francisco Declaration on Research Assessment (DORA). Released in May 2013, DORA has garnered support from thousands of individuals and hundreds of institutions,[28] including in March 2015 the League of European Research Universities (a consortium of 21 of the most renowned research universities in Europe),[85] who have endorsed the document on the DORA website.

Publishers, even those with high impact factors, also recognised the flaws.[86] Nature magazine criticised the over-reliance on JIF, pointing not just to its statistical flaws but to negative effects on science: «The resulting pressures and disappointments are nothing but demoralizing, and in badly run labs can encourage sloppy research that, for example, fails to test assumptions thoroughly or to take all the data into account before submitting big claims.»[87] Various publishers now use a mixture of metrics on their website; the PLOS series of journals does not display the impact factor.[88] Microsoft Academic took a similar view, stating that h-index, EI/SCI and journal impact factors are not shown because «the research literature has provided abundant evidence that these metrics are at best a rough approximation of research impact and scholarly influence.»[89]

In 2021, Utrecht University promised to abandon all quantitative bibliometrics, including the impact factor. The university stated that «it has become a very sick model that goes beyond what is really relevant for science and putting science forward».[90][91] This followed a 2018 decision by the main Dutch funding body for research, NWO, to remove all references to journal impact factors and the h-index in all call texts and application forms.[92] Utrecht’s decision met with some resistance. An open letter signed by over 150 Dutch academics argued that, while imperfect, the JIF is still useful, and that omitting it «will lead to randomness and a compromising of scientific quality».[93]

[edit]

Some related metrics, also calculated and published by the same organization, include:

- Cited half-life: the median age of the articles that were cited in Journal Citation Reports each year. For example, if a journal’s half-life in 2005 is 5, that means the citations from 2001 to 2005 are half of all the citations from that journal in 2005, and the other half of the citations precede 2001.[94]

- Aggregate impact factor for a subject category: it is calculated taking into account the number of citations to all journals in the subject category and the number of articles from all the journals in the subject category.

- Immediacy index: the number of citations the articles in a journal receive in a given year divided by the number of articles published.

- Journal citation indicator (JCI): a JIF that adjusts for scientific field; it is similar to Source Normalized Impact per Paper, calculated based on the Scopus database.[95] JCI is available for all journals in the Web of Science Core Collection (WoS CC) — including the AHCI, ESCI, BCI, CPCI — while JIF is only available for the SCIE and SSCI; however, starting in June 2023, JIF will also be issued for all journals in the WoS CC.[96]

As with the impact factor, there are some nuances to this: for example, Clarivate excludes certain article types (such as news items, correspondence, and errata) from the denominator.[97][98][99][10]

Other measures of scientific impact[edit]

Additional journal-level metrics are available from other organizations. For example, CiteScore is a metric for serial titles in Scopus launched in December 2016 by Elsevier.[100][101] While these metrics apply only to journals, there are also author-level metrics, such as the h-index, that apply to individual researchers. In addition, article-level metrics measure impact at an article level instead of journal level.

Other more general alternative metrics, or «altmetrics», that include article views, downloads, or mentions in social media, offer a different perspective on research impact, concentrating more on immediate social impact in and outside academia.[61][102]

Counterfeit impact factors[edit]

Fake impact factors or bogus impact factors are produced by certain companies or individuals.[103] According to an article published in the Electronic Physician, these include Global Impact Factor, Citefactor, and Universal Impact Factor.[103] Jeffrey Beall maintained a list of such misleading metrics.[104][105] Another deceitful practice is reporting «alternative impact factors», calculated as the average number of citations per article using citation indices other than JCR, even if based on reputable sources such as Google Scholar (e.g., «Google-based Journal Impact Factor»).[106]

False impact factors are often used by predatory publishers.[107][108] Consulting Journal Citation Reports’ master journal list can confirm if a publication is indexed by the Journal Citation Reports.[109] The use of fake impact metrics is considered a red flag.[110]

See also[edit]

- Author impact factor

- Citation impact

- Goodhart’s law

- Journalology

Notes on alternatives[edit]

- ^ «‘Quality Not Quantity’ – DFG Adopts Rules to Counter the Flood of Publications in Research» (Press release). Deutsche Forschungsgemeinschaft (German Research Foundation). 2010. DFG Press Release No. 7.

- ^ «The Leiden Manifesto for Research Metrics». 2015.

- ^ «Plan S implementation guidelines». February 2019.

References[edit]

- ^ a b Waltman L, Traag VA (1 March 2021). «Use of the journal impact factor for assessing individual articles: Statistically flawed or not?». F1000Research. 9: 366. doi:10.12688/f1000research.23418.2. PMC 7974631. PMID 33796272.

- ^ Curry S (February 2018). «Let’s move beyond the rhetoric: it’s time to change how we judge research». Nature. 554 (7691): 147. Bibcode:2018Natur.554..147C. doi:10.1038/d41586-018-01642-w. PMID 29420505.

- ^ a b Hutchins, BI; Yuan, X; Anderson, JM; Santangelo, GM (September 2016). «Relative Citation Ratio (RCR): A New Metric That Uses Citation Rates to Measure Influence at the Article Level». PLOS Biology. 14 (9): e1002541. doi:10.1371/journal.pbio.1002541. PMC 5012559. PMID 27599104.

- ^ «Thomson Corporation acquired ISI». Online. July 1992. Archived from the original on 15 May 2013. Retrieved 26 February 2012.

- ^ «Acquisition of the Thomson Reuters Intellectual Property and Science Business by Onex and Baring Asia Completed».

- ^ «Journal Citation Reports». Web of Science Group. Retrieved 14 September 2019.

- ^ «Web of Science Group». Web of Science Group. 5 August 2019. Retrieved 28 July 2020.

- ^ a b «The Clarivate Impact Factor». Clarivate. 20 June 1994.

- ^ «Nature». 2017 Journal Citation Reports. Web of Science (Science ed.). Thomson Reuters. 2018.

- ^ a b McVeigh ME, Mann SJ (September 2009). «The journal impact factor denominator: defining citable (counted) items». JAMA. 302 (10): 1107–9. doi:10.1001/jama.2009.1301. PMID 19738096.

- ^ Hubbard SC, McVeigh ME (2011). «Casting a wide net: The Journal Impact Factor numerator». Learned Publishing. 24 (2): 133–137. doi:10.1087/20110208. S2CID 20172401.

- ^ «RSC Advances receives its first partial impact factor». RSC Advances Blog. 24 June 2013. Retrieved 16 July 2018.

- ^ Konforti, Boyana (30 July 2014). «Our first (partial) impact factor and our continuing (full) story». Cell Mentor.

- ^ «JCR with Eigenfactor». Archived from the original on 2 January 2010. Retrieved 26 August 2009.

- ^ «ISI 5-Year Impact Factor». APA. Retrieved 12 November 2017.

- ^ Hoeffel C (December 1998). «Journal impact factors». Allergy. 53 (12): 1225. doi:10.1111/j.1398-9995.1998.tb03848.x. PMID 9930604. S2CID 5773127.

- ^ Garfield E (January 2006). «The history and meaning of the journal impact factor». JAMA. 295 (1): 90–3. Bibcode:2006JAMA..295…90G. doi:10.1001/jama.295.1.90. PMID 16391221. S2CID 31183037.

- ^ Garfield E (June 1998). «[The impact factor and its proper application]». Der Unfallchirurg. 101 (6): 413–4. PMID 9677838.

- ^ a b c d Rossner M, Van Epps H, Hill E (December 2007). «Show me the data». The Journal of Cell Biology. 179 (6): 1091–2. doi:10.1083/jcb.200711140. PMC 2140038. PMID 18086910.

- ^ McKiernan EC, Schimanski LA, Muñoz Nieves C, Matthias L, Niles MT, Alperin JP (July 2019). «Use of the Journal Impact Factor in academic review, promotion, and tenure evaluations». eLife. 8. doi:10.7554/eLife.47338. PMC 6668985. PMID 31364991.

- ^ a b c Müller, Ruth; de Rijcke, Sarah (1 July 2017). «Thinking with indicators. Exploring the epistemic impacts of academic performance indicators in the life sciences». Research Evaluation. 26 (3): 157–168. doi:10.1093/reseval/rvx023. ISSN 0958-2029.

- ^ «Time to remodel the journal impact factor». Nature. 535 (7613): 466. July 2016. Bibcode:2016Natur.535..466.. doi:10.1038/535466a. PMID 27466089.

- ^ a b «EASE Statement on Inappropriate Use of Impact Factors». European Association of Science Editors. Retrieved 23 July 2012.

- ^ a b Callaway E (July 2016). «Beat it, impact factor! Publishing elite turns against controversial metric». Nature. 535 (7611): 210–1. Bibcode:2016Natur.535..210C. doi:10.1038/nature.2016.20224. PMID 27411614.

- ^ a b c Brembs B, Button K, Munafò M (2013). «Deep impact: unintended consequences of journal rank». Frontiers in Human Neuroscience. 7: 291. arXiv:1301.3748. Bibcode:2013arXiv1301.3748B. doi:10.3389/fnhum.2013.00291. PMC 3690355. PMID 23805088.

- ^ van Wesel M (February 2016). «Evaluation by Citation: Trends in Publication Behavior, Evaluation Criteria, and the Strive for High Impact Publications». Science and Engineering Ethics. 22 (1): 199–225. doi:10.1007/s11948-015-9638-0. PMC 4750571. PMID 25742806.

- ^ Kansa E (27 January 2014). «It’s the Neoliberalism, Stupid: Why instrumentalist arguments for Open Access, Open Data, and Open Science are not enough». LSE Impact Blog. Retrieved 16 July 2018.

- ^ a b Cabello F, Rascón MT (2015). «The Index and the Moon. Mortgaging Scientific Evaluation». International Journal of Communication. 9: 1880–1887.

- ^ Bornmann L, Daniel HD (2008). «What do citation counts measure? A review of studies on citing behavior». Journal of Documentation. 64 (1): 45–80. doi:10.1108/00220410810844150. hdl:11858/00-001M-0000-0013-7A94-3.

- ^ Anauati MV, Galiani S, Gálvez RM (11 November 2014). «Quantifying the Life Cycle of Scholarly Articles Across Fields of Economic Research». SSRN 2523078.

- ^ van Nierop E (2009). «Why Do Statistics Journals Have Low Impact Factors?». Statistica Neerlandica. 63 (1): 52–62. doi:10.1111/j.1467-9574.2008.00408.x. S2CID 247704905.

- ^ Bohannon J (2016). «Hate journal impact factors? New study gives you one more reason». Science. doi:10.1126/science.aag0643.

- ^ «House of Commons – Science and Technology – Tenth Report». 7 July 2004. Retrieved 28 July 2008.

- ^ Seglen PO (February 1997). «Why the impact factor of journals should not be used for evaluating research». BMJ. 314 (7079): 498–502. doi:10.1136/bmj.314.7079.497. PMC 2126010. PMID 9056804.

- ^ «EASE Statement on Inappropriate Use of Impact Factors». European Association of Science Editors. November 2007. Retrieved 13 April 2013.

- ^ Wilsdon J, Allen L, Belfiore E, Campbell P, Curry S, Hill S, et al. (July 2015). The Metric Tide: Report of the Independent Review of the Role of Metrics in Research Assessment and Management (Report). doi:10.13140/RG.2.1.4929.1363.

- ^ Monastersky R (14 October 2005). «The Number That’s Devouring Science». The Chronicle of Higher Education.

- ^ Arnold DN, Fowler KK (2011). «Nefarious Numbers». Notices of the American Mathematical Society. 58 (3): 434–437. arXiv:1010.0278. Bibcode:2010arXiv1010.0278A.

- ^ Valderrama P, Escabias M, Valderrama MJ, Jiménez-Contreras E, Baca P (March 2020). «Influential variables in the Journal Impact Factor of Dentistry journals». Heliyon. 6 (3): e03575. doi:10.1016/j.heliyon.2020.e03575. PMC 7082530. PMID 32211547.

- ^ a b PLoS Medicine Editors (June 2006). «The impact factor game. It is time to find a better way to assess the scientific literature». PLOS Medicine. 3 (6): e291. doi:10.1371/journal.pmed.0030291. PMC 1475651. PMID 16749869.

- ^ Agrawal AA (April 2005). «Corruption of journal Impact Factors» (PDF). Trends in Ecology & Evolution. 20 (4): 157. doi:10.1016/j.tree.2005.02.002. PMID 16701362. Archived from the original (PDF) on 19 June 2010.

- ^ Fassoulaki A, Papilas K, Paraskeva A, Patris K (August 2002). «Impact factor bias and proposed adjustments for its determination». Acta Anaesthesiologica Scandinavica. 46 (7): 902–5. doi:10.1034/j.1399-6576.2002.460723.x. PMID 12139549. S2CID 20805963.

- ^ Schutte HK, Svec JG (2007). «Reaction of Folia Phoniatrica et Logopaedica on the current trend of impact factor measures». Folia Phoniatrica et Logopaedica. 59 (6): 281–5. doi:10.1159/000108334. PMID 17965570. S2CID 7595296.

- ^ «Journal Citation Reports – Notices». Archived from the original on 15 May 2010. Retrieved 24 September 2009.

- ^ McLeod S (25 September 2020). «Should authors cite sources suggested by peer reviewers? Six antidotes for handling potentially coercive reviewer citation suggestions». Learned Publishing. 34 (2): 282–286. doi:10.1002/leap.1335. ISSN 0953-1513. S2CID 225004022.

- ^ Wilhite AW, Fong EA (February 2012). «Scientific publications. Coercive citation in academic publishing». Science. 335 (6068): 542–3. Bibcode:2012Sci…335..542W. doi:10.1126/science.1212540. PMID 22301307. S2CID 30073305.

- ^ Lynch JG (March 2012). «Business journals combat coercive citation». Science. 335 (6073): 1169.1–1169. Bibcode:2012Sci…335.1169L. doi:10.1126/science.335.6073.1169-a. PMID 22403371.

- ^ Dyer C (February 1997). «Widow can be inseminated with husband’s sperm». BMJ. 314 (7079): 461. doi:10.1136/bmj.314.7079.461d. PMC 2125988. PMID 9056791.

- ^ Gargouri Y, Hajjem C, Lariviere V, Gingras Y, Carr L, Brody T, Harnad S (2018). «The Journal Impact Factor: A Brief History, Critique, and Discussion of Adverse Effects». arXiv:1801.08992 [cs.DL].

- ^ Curry S (February 2018). «Let’s move beyond the rhetoric: it’s time to change how we judge research». Nature. 554 (7691): 147. Bibcode:2018Natur.554..147C. doi:10.1038/d41586-018-01642-w. PMID 29420505.

- ^ Al-Hoorie A, Vitta JP (2019). «The seven sins of L2 research: A review of 30 journals’ statistical quality and their CiteScore, SJR, SNIP, JCR Impact Factors». Language Teaching Research. 23 (6): 727–744. doi:10.1177/1362168818767191. S2CID 149857357.

- ^ Falagas ME, Alexiou VG (2008). «The top-ten in journal impact factor manipulation». Archivum Immunologiae et Therapiae Experimentalis. 56 (4): 223–6. doi:10.1007/s00005-008-0024-5. PMID 18661263. S2CID 7482376.

- ^ Tort AB, Targino ZH, Amaral OB (2012). «Rising publication delays inflate journal impact factors». PLOS ONE. 7 (12): e53374. Bibcode:2012PLoSO…753374T. doi:10.1371/journal.pone.0053374. PMC 3534064. PMID 23300920.

- ^ Fong EA, Wilhite AW (2017). «Authorship and citation manipulation in academic research». PLOS ONE. 12 (12): e0187394. Bibcode:2017PLoSO..1287394F. doi:10.1371/journal.pone.0187394. PMC 5718422. PMID 29211744.

- ^ Adler R, Ewing J, Taylor P (2009). «Citation Statistics: A Report from the International Mathematical Union (IMU) in Cooperation with the International Council of Industrial and Applied Mathematics (ICIAM) and the Institute of Mathematical Statistics (IMS)» (PDF). Statistical Science. 24 (1): 1–14. arXiv:0910.3529. doi:10.1214/09-STS285. ISSN 0883-4237. JSTOR 20697661. S2CID 219477.

- ^ Brembs B (2018). «Prestigious Science Journals Struggle to Reach Even Average Reliability». Frontiers in Human Neuroscience. 12: 37. doi:10.3389/fnhum.2018.00037. PMC 5826185. PMID 29515380.

- ^ Gargouri Y, Hajjem C, Lariviere V, Gingras Y, Carr L, Brody T, Harnad S (2009). «The Impact Factor’s Matthew Effect: A Natural Experiment in Bibliometrics». arXiv:0908.3177 [physics.soc-ph].

- ^ Vessuri H, Guédon JC, Cetto AM (2014). «Excellence or Quality? Impact of the Current Competition Regime on Science and Scientific Publishing in Latin America and Its Implications for Development» (PDF). Current Sociology. 62 (5): 647–665. doi:10.1177/0011392113512839. S2CID 25166127.

- ^ Moore S, Neylon C, Eve MP, O’Donnell DP, Pattinson D (2017). «‘Excellence R Us’: University Research and the Fetishisation of Excellence». Palgrave Communications. 3. doi:10.1057/palcomms.2016.105.

- ^ Owen R, Macnaghten P, Stilgoe J (2012). «Responsible Research and Innovation: From Science in Society to Science for Society, with Society». Science and Public Policy. 39 (6): 751–760. doi:10.1093/scipol/scs093.

- ^ a b Hicks D, Wouters P, Waltman L, de Rijcke S, Rafols I (April 2015). «Bibliometrics: The Leiden Manifesto for research metrics». Nature. 520 (7548): 429–31. Bibcode:2015Natur.520..429H. doi:10.1038/520429a. PMID 25903611.

- ^ «Open Access and the Divide between ‘Mainstream» and «peripheral». Como Gerir e Qualificar Revistas Científicas: 1–25.

- ^ Alperin JP, Muñoz Nieves C, Schimanski LA, Fischman GE, Niles MT, McKiernan EC (February 2019). «How significant are the public dimensions of faculty work in review, promotion and tenure documents?». eLife. 8. doi:10.7554/eLife.42254. PMC 6391063. PMID 30747708.

- ^ Adam D (February 2002). «The counting house». Nature. 415 (6873): 726–9. doi:10.1038/415726a. PMID 11845174. S2CID 4407346.

- ^ Baylis M, Gravenor M, Kao R (September 1999). «Sprucing up one’s impact factor». Nature. 401 (6751): 322. doi:10.1038/43768-c1. PMID 10517624. S2CID 4356889.

- ^ Brembs B (8 January 2016). «Just how widespread are impact factor negotiations?». Retrieved 14 July 2020.

- ^ Callaway E (July 2016). «Beat it, impact factor! Publishing elite turns against controversial metric». Nature. 535 (7611): 210–1. Bibcode:2016Natur.535..210C. doi:10.1038/nature.2016.20224. PMID 27411614.

- ^ Joint Committee on Quantitative Assessment of Research (12 June 2008). «Citation Statistics» (PDF). International Mathematical Union.

- ^ «Not-so-deep impact». Nature. 435 (7045): 1003–4. June 2005. doi:10.1038/4351003b. PMID 15973362.

- ^ Lozano GA, Larivière V, Gingras Y (2012). «The weakening relationship between the impact factor and papers’ citations in the digital age». Journal of the American Society for Information Science and Technology. 63 (11): 2140–2145. arXiv:1205.4328. Bibcode:2012arXiv1205.4328L. doi:10.1002/asi.22731. S2CID 492922.

- ^ Grant B (21 June 2010). «New impact factors yield surprises». The Scientist. Archived from the original on 6 March 2011. Retrieved 31 March 2011.

- ^ McVeigh M (17 June 2010). «What does it mean to be #2 in Impact?». Archived from the original on 12 October 2017. Retrieved 16 July 2018.

- ^ Larivière V, Kiermer V, MacCallum CJ, McNutt M, Patterson M, Pulverer B, et al. (2016). «A Simple Proposal for the Publication of Journal Citation Distributions». bioRxiv 10.1101/062109.

- ^ Kiermer V (2016). «Measuring Up: Impact Factors Do Not Reflect Article Citation Rates». PLOS.

- ^ «Ditching Impact Factors for Deeper Data». The Scientist. Retrieved 29 July 2016.

- ^ Corneliussen S (2016). «Bad summer for the journal impact factor». Physics Today. doi:10.1063/PT.5.8183.

- ^ a b Larivière V, Sugimoto CR (2019), Glänzel W, Moed HF, Schmoch U, Thelwall M (eds.), «The Journal Impact Factor: A Brief History, Critique, and Discussion of Adverse Effects», Springer Handbook of Science and Technology Indicators, Springer Handbooks, Cham: Springer International Publishing, pp. 3–24, arXiv:1801.08992, doi:10.1007/978-3-030-02511-3_1, ISBN 978-3-030-02510-6, S2CID 3677889

- ^ Templ M (19 June 2020). «Modeling and Prediction of the Impact Factor of Journals Using Open-Access Databases: With an Application to the Austrian Journal of Statistics». Austrian Journal of Statistics. 49 (5): 35–58. doi:10.17713/ajs.v49i5.1186. ISSN 1026-597X. S2CID 225704065.

- ^ Stephan, Paula; Veugelers, Reinhilde; Wang, Jian (April 2017). «Reviewers are blinkered by bibliometrics». Nature. 544 (7651): 411–412. Bibcode:2017Natur.544..411S. doi:10.1038/544411a. ISSN 0028-0836. PMID 28447652. S2CID 5197138.

- ^ «Informing Research Choices: Indicators and Judgment». Retrieved 16 August 2021.

- ^ «International Council for Science statement». Icsu.org. 2 May 2014. Archived from the original on 26 April 2017. Retrieved 18 May 2014.

- ^ «Quality not Quantity: DFG Adopts Rules to Counter the Flood of Publications in Research». Deutsche Forschungsgemeinschaft. 23 February 2010. Retrieved 16 July 2018.

- ^ «Departmental H-Index is a more transparent, fair and cost-effective method for distributing funding to universities». Impact of Social Sciences. 8 February 2013. Retrieved 14 August 2021.

- ^ «Business as usual in judging the worth of a researcher?». The Guardian. 30 November 2012. Retrieved 14 August 2021.

- ^ «Not everything that can be counted counts …». League of European Research Universities. 16 March 2015. Archived from the original on 1 December 2017.

- ^ Callaway, Ewen (July 2016). «Beat it, impact factor! Publishing elite turns against controversial metric». Nature. 535 (7611): 210–211. Bibcode:2016Natur.535..210C. doi:10.1038/nature.2016.20224. ISSN 0028-0836. PMID 27411614. S2CID 4452614.

- ^ «Time to remodel the journal impact factor». Nature. 535 (7613): 466. July 2016. Bibcode:2016Natur.535..466.. doi:10.1038/535466a. ISSN 0028-0836. PMID 27466089. S2CID 4463743.

- ^ «PLOS ONE: accelerating the publication of peer-reviewed science». journals.plos.org. Retrieved 14 August 2021.

- ^ «Microsoft Academic». academic.microsoft.com. Archived from the original on 5 January 2017. Retrieved 15 December 2020.

- ^ Woolston C (July 2021). «Impact factor abandoned by Dutch university in hiring and promotion decisions». Nature. 595 (7867): 462. Bibcode:2021Natur.595..462W. doi:10.1038/d41586-021-01759-5. PMID 34172959. S2CID 235647170.

- ^ «Recognition and rewards | Universiteit Utrecht». www.uu.nl. Retrieved 19 July 2021.

- ^ «DORA | NWO». www.nwo.nl. Retrieved 21 July 2021.

- ^ «Scientists at odds on Utrecht University reforms to hiring and promotion criteria». www.natureindex.com. Retrieved 14 August 2021.

- ^ «Impact Factor, Immediacy Index, Cited Half-life». Swedish University of Agricultural Sciences. Archived from the original on 23 May 2008. Retrieved 30 October 2016.

- ^ «Journal impact factor gets a sibling that adjusts for scientific field». Science | AAAS. 30 June 2021. Retrieved 30 June 2021.

- ^ «Web of Science Journal Evaluation Process and Selection Criteria». Clarivate. 26 July 2022. Retrieved 18 January 2023.

- ^ «Bibliometrics (journal measures)». Elsevier. Archived from the original on 18 August 2012. Retrieved 9 July 2012.

A measure of the speed at which content in a particular journal is picked up and referred to.

- ^ «Glossary of Thomson Scientific Terminology». Thomson Reuters. Retrieved 9 July 2012.

- ^ «Journal Citation Reports Contents – Immediacy Index» ((online)). Clarivate Analytics. Retrieved 9 July 2012.

The Immediacy Index is the average number of times an article is cited in the year it is published. The journal Immediacy Index indicates how quickly articles in a journal are cited. The aggregate Immediacy Index indicates how quickly articles in a subject category are cited.

- ^ «Metrics – Features – Scopus – Solutions». www.elsevier.com. Retrieved 9 December 2016.

- ^ Van Noorden R (December 2016). «Controversial impact factor gets a heavyweight rival». Nature. 540 (7633): 325–326. Bibcode:2016Natur.540..325V. doi:10.1038/nature.2016.21131. PMID 27974784.

- ^ Priem J, Taraborelli D, Groth P, Neylon C (26 October 2010). «Altmetrics: A manifesto».

- ^ a b Jalalian M (2015). «The story of fake impact factor companies and how we detected them». Electronic Physician. 7 (2): 1069–72. doi:10.14661/2015.1069-1072. PMC 4477767. PMID 26120416.

- ^ «Misleading Metrics». Scholarly Open Access. Archived from the original on 11 January 2017.

- ^ «Misleading Metrics – Beall’s List».

- ^ Xia J, Smith MP (2018). «Alternative journal impact factors in open access publishing». Learned Publishing. 31 (4): 403–411. doi:10.1002/leap.1200. ISSN 0953-1513.

- ^ Beall J. «Scholarly Open-Access – Fake impact factors». Archived from the original on 21 March 2016.

- ^ Discussion document: Predatory Publishing (Report). Committee on Publication Ethics. 1 November 2019. doi:10.24318/cope.2019.3.6.

- ^ «Master Journal List». Web of Science Group. Clarivate.

- ^ Ebrahimzadeh MH (April 2016). «Validated Measures of Publication Quality: Guide for Novice Researchers to Choose an Appropriate Journal for Paper Submission». The Archives of Bone and Joint Surgery. 4 (2): 94–6. PMC 4852052. PMID 27200383.

Further reading[edit]

- «Does the ‘Impact Factor’ Impact Decisions on Where to Publish?». APS News. American Physical Society. 15 (4). April 2006. Retrieved 1 July 2010.

- Garfield E (October 1999). «Journal impact factor: a brief review». CMAJ. 161 (8): 979–80. PMC 1230709. PMID 10551195.

- Gilbert N (November 2010). «UK science will be judged on impact». Nature. 468 (7322): 357. Bibcode:2010Natur.468..357G. doi:10.1038/468357a. PMID 21085146.

- Groesser SN (2012). «Dynamics of Journal Impact Factors» (PDF). Systems Research and Behavioral Science. 29 (6): 624–644. doi:10.1002/sres.2142.

- Lariviere V, Sugimoto CR (2018). «The Journal Impact Factor: A brief history, critique, and discussion of adverse effects». arXiv:1801.08992 [cs.DL].

- Marcus A, Oransky I (22 May 2015). «What’s Behind Big Science Frauds?». Opinion. The New York Times.

- «Journal & Country Rank: Rankings by Scopus and Scimago Lab». Scopus and Scimago Lab. Scimago. Retrieved 23 October 2018.

This article is about a measure of journal influence. For other similar metrics, see Citation impact.

The impact factor (IF) or journal impact factor (JIF) of an academic journal is a scientometric index calculated by Clarivate that reflects the yearly mean number of citations of articles published in the last two years in a given journal, as indexed by Clarivate’s Web of Science. As a journal-level metric, it is frequently used as a proxy for the relative importance of a journal within its field; journals with higher impact factor values are given the status of being more important, or carry more prestige in their respective fields, than those with lower values. While frequently used by universities and funding bodies to decide on promotion and research proposals, it has come under attack for distorting good scientific practices.[1][2][3]

History[edit]

The impact factor was devised by Eugene Garfield, the founder of the Institute for Scientific Information (ISI) in Philadelphia. Impact factors began to be calculated yearly starting from 1975 for journals listed in the Journal Citation Reports (JCR). ISI was acquired by Thomson Scientific & Healthcare in 1992,[4] and became known as Thomson ISI. In 2018, Thomson-Reuters spun off and sold ISI to Onex Corporation and Baring Private Equity Asia.[5] They founded a new corporation, Clarivate, which is now the publisher of the JCR.[6]

Calculation[edit]

In any given year, the two-year journal impact factor is the ratio between the number of citations received in that year for publications in that journal that were published in the two preceding years and the total number of «citable items» published in that journal during the two preceding years:[7][8]

For example, Nature had an impact factor of 41.577 in 2017:[9]

This means that, on average, its papers published in 2015 and 2016 received roughly 42 citations each in 2017. 2017 impact factors are reported in 2018; they cannot be calculated until all of the 2017 publications have been processed by the indexing agency.

The value of impact factor depends on how to define «citations» and «publications»; the latter are often referred to as «citable items». In current practice, both «citations» and «publications» are defined exclusively by ISI as follows. «Publications» are items that are classed as «article», «review» or «proceedings paper»[10] in the Web of Science (WoS) database; other items like editorials, corrections, notes, retractions and discussions are excluded. WoS is accessible to all registered users, who can independently verify the number of citable items for a given journal. In contrast, the number of citations is extracted not from the WoS database, but from a dedicated JCR database, which is not accessible to general readers. Hence, the commonly used «JCR Impact Factor» is a proprietary value, which is defined and calculated by ISI and can not be verified by external users.[11]

New journals, which are indexed from their first published issue, will receive an impact factor after two years of indexing; in this case, the citations to the year prior to volume 1, and the number of articles published in the year prior to volume 1, are known zero values. Journals that are indexed starting with a volume other than the first volume will not get an impact factor until they have been indexed for three years. Occasionally, Journal Citation Reports assigns an impact factor to new journals with less than two years of indexing, based on partial citation data.[12][13] The calculation always uses two complete and known years of item counts, but for new titles one of the known counts is zero. Annuals and other irregular publications sometimes publish no items in a particular year, affecting the count. The impact factor relates to a specific time period; it is possible to calculate it for any desired period. For example, the JCR also includes a five-year impact factor, which is calculated by dividing the number of citations to the journal in a given year by the number of articles published in that journal in the previous five years.[14][15]

Use[edit]

While originally invented as a tool to help university librarians to decide which journals to purchase, the impact factor soon became used as a measure for judging academic success. This use of impact factors was summarised by Hoeffel in 1998:[16]

Impact Factor is not a perfect tool to measure the quality of articles but there is nothing better and it has the advantage of already being in existence and is, therefore, a good technique for scientific evaluation. Experience has shown that in each specialty the best journals are those in which it is most difficult to have an article accepted, and these are the journals that have a high impact factor. Most of these journals existed long before the impact factor was devised. The use of impact factor as a measure of quality is widespread because it fits well with the opinion we have in each field of the best journals in our specialty….In conclusion, prestigious journals publish papers of high level. Therefore, their impact factor is high, and not the contrary.

As impact factors are a journal-level metric, rather than an article- or individual-level metric, this use is controversial. Eugene Garfield, the inventor of the JIF agreed with Hoeffel,[17] but warned about the «misuse in evaluating individuals» because there is «a wide variation [of citations] from article to article within a single journal».[18] Despite this warning, the use of the JIF has evolved, playing a key role in the process of assessing individual researchers, their job applications and their funding proposals. In 2005, The Journal of Cell Biology noted that:

Impact factor data … have a strong influence on the scientific community, affecting decisions on where to publish, whom to promote or hire, the success of grant applications, and even salary bonuses.[19]

More targeted research has begun to provide firm evidence of how deeply the impact factor is embedded within formal and informal research assessment processes. A review in 2019 studied how often the JIF featured in documents related to the review, promotion, and tenure of scientists in US and Canadian universities. It concluded that 40% of universities focussed on academic research specifically mentioned the JIF as part of such review, promotion, and tenure processes.[20] And a 2017 study of how researchers in the life sciences behave concluded that «everyday decision-making practices as highly governed by pressures to publish in high-impact journals». The deeply embedded nature of such indicators not only effect research assessment, but the more fundamental issue of what research is actually undertaken: «Given the current ways of evaluation and valuing research, risky, lengthy, and unorthodox project rarely take center stage.»[21]

Criticism[edit]

Numerous critiques have been made regarding the use of impact factors, both in terms of its statistical validity and also of its implications for how science is carried out and assessed.[3][22][23][24][25] A 2007 study noted that the most fundamental flaw is that impact factors present the mean of data that are not normally distributed, and suggested that it would be more appropriate to present the median of these data.[19] There is also a more general debate on the validity of the impact factor as a measure of journal importance and the effect of policies that editors may adopt to boost their impact factor (perhaps to the detriment of readers and writers). Other criticism focuses on the effect of the impact factor on behavior of scholars, editors and other stakeholders.[26] Further criticisms argue that emphasis on impact factor results from the negative influence of neoliberal politics on academia. Some of these arguments demand not just replacement of the impact factor with more sophisticated metrics but also discussion on the social value of research assessment and the growing precariousness of scientific careers in higher education.[27][28]

Inapplicability of impact factor to individuals and between-discipline differences[edit]

It has been stated that impact factors in particular and citation analysis in general are affected by field-dependent factors[29] which invalidate comparisons not only across disciplines but even within different fields of research of one discipline.[30] The percentage of total citations occurring in the first two years after publication also varies highly among disciplines from 1–3% in the mathematical and physical sciences to 5–8% in the biological sciences.[31] Thus impact factors cannot be used to compare journals across disciplines.

Impact factors are sometimes used to evaluate not only the journals but the papers therein, thereby devaluing papers in certain subjects.[32] In 2004, the Higher Education Funding Council for England was urged by the House of Commons Science and Technology Select Committee to remind Research Assessment Exercise panels that they are obliged to assess the quality of the content of individual articles, not the reputation of the journal in which they are published.[33] Other studies have repeatedly stated that impact factor is a metric for journals and should not be used to assess individual researchers or institutions.[34][35][36]

Questionable editorial policies that affect the impact factor[edit]

Because impact factor is commonly accepted as a proxy for research quality, some journals adopt editorial policies and practices, some acceptable and some of dubious purpose, to increase its impact factor.[37][38] For example, journals may publish a larger percentage of review articles which generally are cited more than research reports.[8] Research undertaken in 2020 on dentistry journals concluded that the publication of «systematic reviews have significant effect on the Journal Impact Factor … while papers publishing clinical trials bear no influence on this factor. Greater yearly average of published papers … means a higher impact factor.»[39]

Journals may also attempt to limit the number of «citable items»—i.e., the denominator of the impact factor equation—either by declining to publish articles that are unlikely to be cited (such as case reports in medical journals) or by altering articles (e.g., by not allowing an abstract or bibliography in hopes that Journal Citation Reports will not deem it a «citable item»). As a result of negotiations over whether items are «citable», impact factor variations of more than 300% have been observed.[40] Items considered to be uncitable—and thus are not incorporated in impact factor calculations—can, if cited, still enter into the numerator part of the equation despite the ease with which such citations could be excluded. This effect is hard to evaluate, for the distinction between editorial comment and short original articles is not always obvious. For example, letters to the editor may be part of either class.

Another less insidious tactic journals employ is to publish a large portion of its papers, or at least the papers expected to be highly cited, early in the calendar year. This gives those papers more time to gather citations. Several methods, not necessarily with nefarious intent, exist for a journal to cite articles in the same journal which will increase the journal’s impact factor.[41][42]

Beyond editorial policies that may skew the impact factor, journals can take overt steps to game the system. For example, in 2007, the specialist journal Folia Phoniatrica et Logopaedica, with an impact factor of 0.66, published an editorial that cited all its articles from 2005 to 2006 in a protest against the «absurd scientific situation in some countries» related to use of the impact factor.[43] The large number of citations meant that the impact factor for that journal increased to 1.44. As a result of the increase, the journal was not included in the 2008 and 2009 Journal Citation Reports.[44]

Coercive citation is a practice in which an editor forces an author to add extraneous citations to an article before the journal will agree to publish it, in order to inflate the journal’s impact factor.[45] A survey published in 2012 indicates that coercive citation has been experienced by one in five researchers working in economics, sociology, psychology, and multiple business disciplines, and it is more common in business and in journals with a lower impact factor.[46] Editors of leading business journals banded together to disavow the practice.[47] However, cases of coercive citation have occasionally been reported for other disciplines.[48]

Assumed correlation between impact factor and quality[edit]

The journal impact factor was originally designed by Eugene Garfield as a metric to help librarians make decisions about which journals were worth indexing, as the JIF aggregates the number of citations to articles published in each journal. Since then, the JIF has become associated as a mark of journal «quality», and gained widespread use for evaluation of research and researchers instead, even at the institutional level. It thus has significant impact on steering research practices and behaviours.[49][50][51]

By 2010, national and international research funding institutions were already starting to point out that numerical indicators such as the JIF should not be considered as a measure of quality.[note 1] In fact, research was indicating that the JIF is a highly manipulated metric,[52][53][54] and the justification for its continued widespread use beyond its original narrow purpose seems due to its simplicity (easily calculable and comparable number), rather than any actual relationship to research quality.[55][56][57]

Empirical evidence shows that the misuse of the JIF—and journal ranking metrics in general—has a number of negative consequences for the scholarly communication system. These include gaps between the reach of a journal and the quality of its individual papers[25] and insufficient coverage of social sciences and humanities as well as research outputs from across Latin America, Africa, and South-East Asia.[citation needed] Additional drawbacks include the marginalization of research in vernacular languages and on locally relevant topics and inducement to unethical authorship and citation practices. More generally, the impact factors fosters a reputation economy, where scientific success is based on publishing in prestigious journals ahead of actual research qualities such as rigorous methods, replicability and social impact. Using journal prestige and the JIF to cultivate a competition regime in academia has been shown to have deleterious effects on research quality.[58]

A number of regional and international initiatives are now providing and suggesting alternative research assessment systems, including key documents such as the Leiden Manifesto[note 2] and the San Francisco Declaration on Research Assessment (DORA). Plan S calls for a broader adoption and implementation of such initiatives alongside fundamental changes in the scholarly communication system.[note 3] As appropriate measures of quality for authors and research, concepts of research excellence should be remodelled around transparent workflows and accessible research results.[59][60][61]

JIFs are still regularly used to evaluate research in many countries, which is a problem since a number of issues remain around the opacity of the metric and the fact that it is often negotiated by publishers.[62][63][19]

Negotiated values[edit]

Results of an impact factor can change dramatically depending on which items are considered as «citable» and therefore included in the denominator.[64] One notorious example of this occurred in 1988 when it was decided that meeting abstracts published in FASEB Journal would no longer be included in the denominator. The journal’s impact factor jumped from 0.24 in 1988 to 18.3 in 1989.[65] Publishers routinely discuss with Clarivate how to improve the «accuracy» of their journals’ impact factor and therefore get higher scores.[40][25]

Such discussions routinely produce «negotiated values» which result in dramatic changes in the observed scores for dozens of journals, sometimes after unrelated events like the purchase by one of the larger publishers.[66]

Distribution skewness[edit]

Journal impact factors are influenced heavily by a small number of highly cited papers. In general, most papers published in 2013–14 received many fewer citations than indicated by the impact factor. Two journals (Nature [blue], PLOS ONE [orange]) are shown to represent a highly cited and less cited journal, respectively. The high citation impact of Nature is derived from relatively few highly cited papers. Modified after Callaway 2016.[67]

Because citation counts have highly skewed distributions,[24] the mean number of citations is potentially misleading if used to gauge the typical impact of articles in the journal rather than the overall impact of the journal itself.[68] For example, about 90% of Nature‘s 2004 impact factor was based on only a quarter of its publications. Thus the actual number of citations for a single article in the journal is in most cases much lower than the mean number of citations across articles.[69] Furthermore, the strength of the relationship between impact factors of journals and the citation rates of the papers therein has been steadily decreasing since articles began to be available digitally.[70]

The effect of outliers can be seen in the case of the article «A short history of SHELX», which included this sentence: «This paper could serve as a general literature citation when one or more of the open-source SHELX programs (and the Bruker AXS version SHELXTL) are employed in the course of a crystal-structure determination». This article received more than 6,600 citations. As a consequence, the impact factor of the journal Acta Crystallographica Section A rose from 2.051 in 2008 to 49.926 in 2009, more than Nature (at 31.434) and Science (at 28.103).[71] The second-most cited article in Acta Crystallographica Section A in 2008 had only 28 citations.[72]

Critics of the JIF state that use of the arithmetic mean in its calculation is problematic because the pattern of citation distribution is skewed[73] and citation distributions metrics have been proposed as an alternative to impact factors.[74][75][76]

However, there have also been pleas to take a more nuanced approach to judging the distribution skewness of the impact factor. Waltman and Traag[who?], in their 2021 paper, ran numerous simulations and concluded that «statistical objections against the use of the IF at the level of individual articles are not convincing», and that «the IF may be a more accurate indicator of the value of an article than the number of citations of the article».[1]

Lack of reproducibility[edit]

While the underlying mathematical model is publicly known, the dataset which is used to calculate the JIF is not publicly available. This prompted criticism: «Just as scientists would not accept the findings in a scientific paper without seeing the primary data, so should they not rely on Thomson Scientific’s impact factor, which is based on hidden data».[19] However, a 2019 article demonstrated that «with access to the data and careful cleaning, the JIF can be reproduced», although this required much labour to achieve.[77] A 2020 research paper went further. It indicated that by querying open access or partly open-access databases, like Google Scholar, ResearchGate, and Scopus, it is possible to calculate approximate impact factors without the need to purchase Web of Science / JCR.[78]

Broader negative impact on science[edit]

Just as the impact factor has attracted criticism for various immediate problems associated with its application, so has there also been criticism that its application undermines the broader process of science. Research has indicated that bibliometrics figures, particularly the impact factor, decrease the quality of peer review an article receiving,[79] a reluctance to share data,[21] decreasing quality of articles,[80] and a reduced scope in terms of what they can research. «For many researchers the only research questions and projects that appear viable are those that can meet the demand of scoring well in terms of metric performance indicators — and chiefly the journal impact factor.».[21] Furthermore, the process of publication and science is slowed down — authors automatically try and publish with the journals with the highest impact factor — «as editors and reviewers are tasked with reviewing papers that are not submitted to the most appropriate venues».[77]

Institutional responses to criticism of the impact factor[edit]

Given the growing criticism and its widespread usage as a means of research assessment, organisations and institutions have begun to take steps to move away from the journal impact factor. In November 2007 the European Association of Science Editors (EASE) issued an official statement recommending «that journal impact factors are used only—and cautiously—for measuring and comparing the influence of entire journals, but not for the assessment of single papers, and certainly not for the assessment of researchers or research programmes».[23]

In July 2008, the International Council for Science Committee on Freedom and Responsibility in the Conduct of Science issued a «statement on publication practices and indices and the role of peer review in research assessment», suggesting many possible solutions—e.g., considering a limit number of publications per year to be taken into consideration for each scientist, or even penalising scientists for an excessive number of publications per year—e.g., more than 20.[81]

In February 2010, the Deutsche Forschungsgemeinschaft (German Research Foundation) published new guidelines to reduce the number of publications that could be submitted when applying for funding: «The focus has not been on what research someone has done but rather how many papers have been published and where.» They noted that for decisions concerning «performance-based funding allocations, postdoctoral qualifications, appointments, or reviewing funding proposals, [where] increasing importance has been given to numerical indicators such as the h-index and the impact factor».[82] The UK’s Research Assessment Exercise for 2014 also banned the journal impact factor[83] although evidence suggested that this ban was often ignored.[84]